1年後には「HRP-4C」が歌って踊る、「ダンスロボットプロジェクト」始動へ

~ロボット研究者らとダンサーSAM氏によるトークセッション開催

|

| トークセッションの様子 |

展示に関する記事でお知らせしているように「Digital Content EXPO 2009」が22日から24日の日程で、日本科学未来館ほかにて開催された。10月23日には、「HRP-4C」がステージで披露した寸劇のメイキングや今後の発展可能性について、開発者である独立行政法人 産業技術総合研究所知能システム研究部門副部門長の横井一仁氏、振り付けを行なったダンサーのSAM氏、そしてモデレーターである東京大学IRT研究機構の石川勝氏らによるトークセッションが行なわれた。セッションには「HRP-4C」が実行した振り付けのモデル「動作アクトレス」となった女優の渡邊小百合(わたなべ・さゆり)氏、モーション・ソフトウェアを開発した産総研の中岡慎一郎氏、先日の「CEATEC」でのデモを仕掛けたヤマハ株式会社の大島治氏らも登場した。そしてセッション中に、来年の「Digital Content EXPO」では「HRP-4C」をダンスさせることを目指す「ダンスロボットプロジェクト」の始動が発表された。

|  |  |

|  |  |

|  |  |

●クリエイターがロボットのモーションを作る

|

| 東京大学IRT研究機構 特任研究員 石川勝氏 |

モデレーターの石川勝氏はまず「デジタルコンテンツ」の象徴としてミニブログサービス「Twitter」での「HRP-4C 未夢(ミーム)」の評判を閲覧。そして今回のデモのメイキング紹介を始めた。声をかけたのは石川氏らであり、当初SAM氏は「ロボットの世界はまったく知らなかった」という。石川氏は冗談まじりに「最初は『TRFのメンバーになれないか』と思ったのだが、まだ現状のロボットは体力が追いついていない。だからまずはアクターを目指した」と述べた。

では、どんな手順で演技の振り付け動作を決めていったのか。基本的なロボット動作の生成については産総研 知能システム研究部門副部門長の横井一仁氏から紹介された。ヒューマノイドの動きを作るにしてもさまざまな手法がある。モーションキャプチャーで動きを取り込む方法もあるし、一つ一つプログラミングしていく手法もある。だが今回はコンテンツを重視した。横井氏は「我々のような技術者がコンテンツを作ることは難しい。コンテンツはクリエイターに作ってもらいたいと考えた。そこで女優が演技する動画を撮影し、それに沿った形で動作を作った」と紹介した。女優に演技してもらった動きをそのままモーションキャプチャーで取り込んだわけではない。演出家、振付家、ゲームクリエイターが使えるようなソフトウェアを創りたい、と考えたからだ。

石川氏はこの「コンテンツクリエイターがロボットの動きを作る」ということについて「それが今回の一番のキーワード」と強調。そのような環境を実現するために、モーキャプする専用のスタジオがなくても、家庭のPC上でロボットモーションが作れるソフトウェアを開発したという。そして実際に動きを担当した「動作アクトレス」となった、女優の渡邊小百合氏が紹介された。渡邊氏は「HRP-4C」に対面したときの最初の印象を「メイクもしていて、すごくリアルだった」と語った。本誌読者は既にご存知のとおり、「HPR-4C」の外形寸法は日本人女性の平均を基にしている。顔も女性職員の「平均顔」がベースだ。顔は株式会社ココロが製作しているが、「そちらのクリエイターの好みが多少入っているんだろうなと思う」と述べた。

|  |  |

| 独立行政法人 産業技術総合研究所知能システム研究部門副部門長 横井一仁氏 | 演出プロデュースを行なったダンサーのSAM氏 | 「動作アクトレス」をつとめた女優 渡邊小百合氏 |

●振り付け「ロボットが行なう人間の動き」とは

|

| SAM氏(左)と渡邊小百合氏(右) |

さて、実際の演技はどのように作られていったのか。SAM氏は「ロボットだと『無駄なアクション』が必要になってくる。そこが彼女が苦労したところだろう」とコメントした。例えば、何もしてない様子であっても、ロボットの場合、本当に何もしていないと、ただ止まった状態になってしまう。そういった部分を分かりやすい形で作っていく作業が必要だったという。また、「ロボットがこういう動きをしたら面白いだろうな」と思われるような動作も作っていった、という。完全に人間そのままでもなくロボットっぽい動きでもない、その中間のような動き。そのなかで一番面白い動き、リアルに見える動きを作っていったとSAM氏は語った。

今回の寸隙のシナリオは構成作家が考えたもので、「HRP-4C」のようなリアルなヒューマノイドがいろいろな場所にレンタルされていき、メンテのために戻って来たときに今後のサービス向上のためにログを解析するために「HRP-4C」が見ていた家族の動きを再現するという設定だ。演技をした女優の渡邊小百合氏は、「自分の動きがそのままロボット上に再現された」と語る一方で、例えば指が曲げられないといった制限があったので手を使った動きの表情が出せず、そこは苦労したと語った。また、将来は顔の表情の変化、目の大きさの変化も加えることができれば、感情の出し方の幅がもっと広がるのではないか、とコメントした。

SAM氏は「普段の人間の動きは実際にはかなり細かい」と触れ、今後は、細かい首や体の角度などもっと細かい角度が要求されていくのではないかと語った。今回は制限のある中で、分かりやすいオーバージェスチャーにしつつ、リアルに見える、「ロボットが行なう人間の動き」として「リアルに見える」ものを目指したと演出意図を解説した。産総研の横井氏は今回は諸般の都合で固定スタンドに立たせっぱなしとなったことから肩の動きが制限されたことなどについて触れ、そこに振り付けの苦労があったのだろうと受けた。

次は音声だ。今回はプロの声優が、渡邊氏が演じた動作を見ながら吹き込んだ。3種類の女性の声が今回のデモでは登場しているが、すべて一人があてている。これで音声ファイルができたので、映像と音声がそろった。次が、いよいよ動きの生成になる。今回は、産総研の中岡氏、三浦氏らが動画のモーションを見ながらモーションを生成していった。横井氏は「我々はビデオを見ながら作ったが、たとえばCGやアニメーションのクリエイターならば、『このセリフならこの動き』ということが頭に入っているだろうからビデオなしで動きが作れるのではないか」と語り、そういうことができるソフトウェアを作ろうとしている、と述べ、セッションは次のソフトウェアの解説に入った。

|  |  |

| 【動画】振り付けを行なっている様子。「ロボットが行なう人間の動き」を狙ったという | 手や顔の表情の変化を使えればもっと感情が出せると語る渡邊小百合氏 | 音声録音の様子 |

●ロボットモーションソフトウェア

|

| 産総研 知能システム研究部門 ヒューマノイド研究グループ 研究員 中岡慎一郎氏 |

石川氏はここで今後の方向性について、SAM氏も交えて「『ダンスロボットプロジェクト』をこの場からスタートしたい」と発表した。「ダンスができるロボットについての公開ミーティングとしてこのトークセッションを位置づける」と述べ、「クリエイターと技術者の立場で語り合っていきたい」と語り、モーションソフトウェアを開発している産総研 知能システム研究部門ヒューマノイド研究グループ 研究員の中岡慎一郎氏を紹介した。

中岡慎一郎氏は、「3DCGのアニメーション作成ツールの感覚でロボット実機の動きを作ることができる」ソフトウェアの開発を行なっている。CGでは「キー」となる姿勢、「キーポーズ」をソフトウェア上で与える。そして関節角をスライダで動かしたり、右の姿勢を左にコピーするといった作業で振り付けする。それと同様の使い方でロボット実機に振り付けをできるソフトウェアだ。

中岡氏が作っているソフトウェア「Robotics Motion Studio」の特徴は、実機に合わせた形で、自動的に動きを修正できるところだ。CG上で何となく動くような動作を作っても、ロボット実機のダイナミクスにあっていなければ実際には動けない。転倒してしまう。今回は上半身だけだったのでその制約は少なかったそうだが、中岡氏は、オートバランサーを入れた場合とオフにした場合とを比較し、機能を紹介した。特に、キーポーズの編集を行なうたびに、随時、バランスが取れるように微修正が働く点がこのソフトウェアの特徴だという。

横井氏は「まずは動力学シミュレーションで動作を試すのが従来のやり方だった。だがこういうソフトウェアを使えば、最初から転ばないシミュレーションが可能になる」と評価した。ただ一方で「これはシミュレーションであって、実環境での実機の動作の間にはまた壁がある」と述べた。

また、従来に比べれば比較的簡単、といってもあくまで相対的なものである。このソフトウェアを使うことを期待されるのはSAM氏のようなクリエイターであるわけだが、SAM氏は「キーポーズ」を人が与えないといけないこと、また何よりコンピュータの基本的な使い方を理解しないといけないことに懸念を示した。中岡氏はより一般の人でも取っ付きやすいインターフェイスを目指して開発していくという。なお、マルチプラットフォームのソフトウェアツールとして、今年度中の一般公開を目指しているとのことだ。現状でより詳細を知りたい方は、こちらのウェブサイトをご覧頂きたい。

|  |  |

| 【動画】「Robotics Motion Studio」の基本機能はCGのモーション作成ソフトウェアと似ている | 【動画】歩行してキックする動作を生成。オートバランサーをオフで動力学シミュレーションを実行すると、転倒してしまう | 【動画】バランサーをオンにするとユーザーが与えた姿勢を自動で修正する。キーポーズの編集を行なうたびに随時、修正が働く |

●ゆくゆくは激しい踊りも可能に?

|

| SAM氏(左)と産総研 中岡氏(右) |

ここで石川氏は、中岡氏による2005年の研究「HRP-2」による「会津磐梯山踊り」を動画で会場に見せた。東大池内研究室で行なったものだ。このときは、踊りの師匠の動きをモーションキャプチャーで取り込んでいる。人間の動きを自由度やトルク、速度の異なるロボットのボディにそのまま入れても転んでしまうので、いかに人の動きをロボットに適用するかというところで技術的な工夫をした。

SAM氏がそもそも今回のダンスの話に乗った一つの理由は、「会津磐梯山踊り」のデモを実際に見たことだったという。ロボットといえば直線的な動きしかできないと思っていたため、かなりびっくりしたそうだ。「足を前に出すと首や腕がついていくし、スムーズでスピーディ。これを見たときに、ロボットもダンスできると思った」と語り、「これだけ速く動けるのであれば、先も見える」とコメントした。

|

| 産総研 横井一仁氏 |

HRP-4CはまだHRP-2のような動きはできていない。横井氏は「HRP-2」とHRP-4C」の違いについて述べた。両者は、まず外形が違う。「HRP-4C」は女性型で非常にスリムにデザインされている。そのためモーターのパワーもそれほどなく、素早い動きにはあまり向いていない。

HRP(ヒューマノイド・ロボット・プラットフォーム)シリーズのうち、「HRP-3」と「HRP-2」は「働くヒューマノイドロボット」を目指していたため、ある程度の力を出せるように作られたロボットだ。いっぽうHRP-4Cはコンテンツ産業向けに作られたため、“箸より重たいものは持てない”が、それでもいいというコンセプトで設計されている。そういう面では激しいダンスには「HRP-2」のほうが向いている。またロボットの場合、人間と違って体を鍛えても体力はつかない。逆に「こんな踊りをさせたい」という要求に応じる形で徐々に改良していきたいと述べた。

石川氏は「ゆくゆくはSAMさんのような踊りをさせてみたい」と述べ、SAM氏に人間の場合ならばダンスする際、どんな動きが必要で、どこを鍛えなければならないか問うた。SAM氏は石川氏の求めに応じて、実演を交えて、まずは片足バランスが必要で、あとはジャンプや足をクロスさせる動きが必要だと述べた。

中岡氏は「ロボットは片足バランスは得意。クロスも足をぶつけない形であればできると思う。でも動きを溜めてバンと出すジャンプはけっこう難しい」とこたえた。だが足を接地させたまま腰の上下動をし、片足をすっとあげるといったかたちで、ジャンプしたかのように見せることはできるかもしれないと語った。横井氏は「ダンサーはスリムでも筋肉で締まっている。だがロボットはこのサイズだとこのパワーしかでない。このボディのままだと難しいところがある」とコメントした。腕や足を伸ばすとなると、それはまた別のハードウェア、別のロボットを作るということになり、そのためには新たな投資が必要となる。

SAM氏は「限界を考えながら振り付けをしていくことはできると思います。会津磐梯山を見たときに可能性が広がった。でも研究開発ならば、もっと突っ込んだところが必要だろう。頭のなかでは構想はできている」と述べた。そして一同から、来年には実現したいという意思表明が行なわれた。中岡氏は「本当に光栄で嬉しい。私はずっとこれを目指して研究してきたので」と喜びを語った。

|  |  |

| 【動画】こんな動きができると良いと基本動作を実演するSAM氏と応える中岡慎一郎氏 | 「既にロボットダンスの構想はある」と語るSAM氏 | 「本当に光栄」と語る中岡慎一郎氏 |

●多様化し始めたロボット・コンテンツ

|

| ヤマハ株式会社サウンドテクノロジー開発センター 大島治氏 |

「HRP-4C」は、ダンス以外にもさまざまなチャレンジを行なっている。ここで「HRP-4C」の腰の自由度を使った体操動作から、デビュー直後にファッションウィークでMCとして登場したとき、桂由美氏デザインのウェディングドレスで登場したときの様子、そしてCEATECでのヤマハの歌声合成エンジン「VOCALOID」を使った歌が紹介され、ヤマハ株式会社サウンドテクノロジー開発センターの大島治氏が登場した。

横井氏は「MC、ファッションモデル、歌手、いずれもコンテンツは外部から得ている」と述べ「良いハードウェアを作る技術は産総研が持っている。でもそこで走るコンテンツがないと売れるものにはならない。だからコラボレーションはどんどん進めていきたい」と語った。

ボーカロイドも、よりインタフェースを簡易化していくことで、ユーザー層を広げようとしている。歌う「HRP-4C」の動画を見たSAM氏からは「3体か4体で、歌って踊るユニットができると面白いですね」というコメントがあった。

「CEATEC」のデモでは口の動きは歌声にリップシンクしていた。このときはまず母音にあたる口の開け方を考え、いくつかの子音、そして移行時の口の動き方も含めて十数個の口のパターンを用意した。そしてVOCALOIDの場合はどの音素を出すかは分かっているので、その口の動きを生成するという形で唇の動きが作られた。

大島氏は「私もできあがったものを見て感動した」とコメントし、「CEATECで悩みの種だったのはキャラクター。声は大事な要素だと思う。例えば『初音ミク』には世界観がある。その世界観をHRP-4Cに持っていっていいのかどうかは悩むところがあった。結局、コスプレをしたけれど素の状態のときもあった。そのときにはクリプトンから未発表の声を提供してもらった」と背景を語った。石川氏は「タレント業が始まっているような感じ」と述べ、「いよいよロボットコンテンツが多様化しつつある。今年はロボットコンテンツ元年ではないか」と語った。

|  |  |

| ファッションショーのMCでデビュー | ウェディングドレス姿を披露 | CEATECでは歌を歌った |

●ダンスや歌を通して向上した技術を実用技術へと還元

|

| 東京大学IRT研究機構 石川勝氏 |

いっぽう、エンターテイメント以外にもロボットには色々な可能性がある。そして石川氏は所属である東京大学IRT研究機構が開発した家事ロボットを紹介。実用ロボットにおいてもコンテンツは重要だと述べた。

SAM氏は「ダンスよりも先に実用ロボットを開発してもらいたい(笑)」とコメントし、「モノを持ったり、繊細な動きまでできるようになると実用的なロボットができるのではないか」と語った。横井氏も「我々のチームもHRP-4Cだけを使っているわけではなく、働くロボットも考えている。このイベントは経済産業省主催だが、そちらでも生活支援ロボット実用化プロジェクトが始まっている。芸能だけがコンテンツではない。ロボットがやれることがすべてコンテンツ、それを広げていかないとダメだと考えている」と述べた。

SAM氏は「ダンスや歌を行なう中でロボット技術が向上して、それが働くロボットに還元される。より難しいことをすることで技術が伸びるのではないか。そういう面でお手伝いしたい」と語った。

石川氏はコンテンツとハードウェアの関係について語り、「メーカーだけではロボットは普及しない。家庭の状況もやってもらいたいことも千差万別なので、ものすごく豊富なコンテンツが必要になってくる。アプリをシチュエーションに応じてダウンロードできることも大事。こういうコンテンツの担い手が、大勢の若手のクリエイターたちだろうと思う」と述べた。たとえば、アップルの「iPhone」を買うといろんなコンテンツがダウンロードできる。そういう体験の総体に我々はカネを払っている。ヤマハの大島氏は自社の楽器販売について語り、「楽器はそれ自体が完成品ではない。楽器を使ってユーザーがどういうコンテンツを作るか。それをお手伝いしているのが我々だと考えている。コンテンツ作りを皆さんが楽しめるような時代をつくりたいと考えている」と同意を示した。

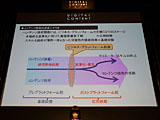

石川氏は「コンテンツ技術マップ」を示し、「コンテンツは技術がないと生まれないし、技術はコンテンツがないと成長しない。両者は双子の関係にある。それがプラットフォームの登場で産業化・普及していく」と述べ、テレビの受像機やインフラの技術と、番組作りの違いを例に出して解説した。

それぞれは別のスキルが必要で、互いにそれを持ち寄る事で面白いものを見る事ができる。そして「ロボットも役割分担をして、楽しいコンテンツを作る時代になったと思う」と述べた。横井氏は「研究者が全部を作っていては伸びない。ポストプラットフォーム期に行かないと、ロボット産業全体が伸びない」と述べ、取りあえずは簡単なモーションを作れるようになることを目指すと述べた。中岡氏は、ロボットとソフトウェアについて「実際に使うことで、どこが足らないのか分かってくる。こういう機会を通して改良していけることにワクワクする」と楽しそうにコメントした。

最後に石川氏は「DIGITAL CONTENT EXPO 2009」のエグザグティブプロデューサーとしての立場から、シンボルの「デジタルコンテンツの森」のイラストを意味を解説した。この絵には3つの意味があるという。まずはコンテンツの実を大きくして海外市場に売って出ようという意味。もう一つはコンテンツを支え、養分となる技術がコンテンツを大きくしていく上では非常に重要になる、という面。3つ目は「コンテンツの木」だけではなく、コンテンツ産業がその横にある「環境」や「クルマ」など他の木の栄養になってもいいのではないかという意味だという。

そして最後に「ロボットもコンテンツが大事だし、コンテンツを作るのがこれからクリエイターの力でどんどん成長していくんだということをわかってもらいたい」と語った。それを聞いたSAM氏は「凄いプロジェクトの中に入れて頂いたんだなと分かった」と述べ、そして「このロボットがダンスをすることで、これまでに不可能なことが可能になったり、ある程度ハードルが高いところを超えたほうが、技術の普及に役立てるんだということが分かった」と語り、トークセッションが締めくくられた。

|  |  |

| コンテンツとハードウェアの関係 | コンテンツ技術の成長シナリオ | デジタルコンテンツの森 |

●ロボットならではのコンテンツ技術利用法とは?

|

| HRP-4C |

最後に、蛇足だが筆者個人の所見を述べたい。ロボットの普及においてコンテンツをはじめとした、これまでロボットに関わっていなかった種類のプロフェッショナルが必要となることは間違いない。むしろ、そうなることで新産業が生まれると考えられているからこそ、ロボットは期待されているのである。「HRP-4C」一つとっても、「なんでもやる」のではなく、そろそろディレクションやブランディングを行なう人材が必要なのではないかと思われる。

いっぽう、ヤマハ「VOCALOID」にせよ桂由美ウェディングドレスにせよ、試しに適用してみたことによって、コンテンツ側もまだロボットを迎え入れる準備が十分ではないことが分かってしまった面もあると思う。「VOCALOID」はロボットである「HRP-4C」に適用することでむしろ合成音声っぽさが目立ってしまった。

またウェディングドレスはロボット本来のデザインである銀色ボディを完全に覆い隠したもので、歩行による振動を抑制することもできなかった。例えば歩行時にドレスによる重量が問題になるのであれば、逆にドレスは揺れを抑制するような形でデザインされるべきだろう。声にしても、人間でもなく、いわゆるロボット声でもない、正解の声があるのかもしれない。HRP-4Cの顔は平均顔だが、その顔から出るだろうと想定する声のようなものが、平均顔を見た人間側にはおそらくあるはずだ。

何にしてもヒューマノイドロボットはいくら人に似せられていても人ではなく、ロボットである。人ではない人に似せた機械であることは見ている人もみんな分かっていて、なおかつ何か面白いものを期待しているのだ。ロボットに対しては「ロボットらしさ」を活かした、ロボットに合った技術の適用があるはずだ。だがコンテンツ側も、これまでになかったプロダクトであるロボットに、うまくハマる技術の適用法を見出していない。

ともかく、トライはまだまだ始まったばかり。中岡氏が語ったように、今後も多くの挑戦を続けることで課題が浮き彫りになり、改良すべき点がクリアになってくるのだろう。そして将来は、コンテンツ側とロボット技術側双方に、相乗効果が生み出されるようになるに違いない。両者のこれからの進歩に期待する。

2009/10/26 19:04