|

記事検索 |

最新ニュース |

|

|

||||||||||||||||||||||||||||||||||||||

|

「ソフトウェア・ロボット・自動車の未来」 |

||||||||||||||||||||||||||||||||||||||

|

|

||||||||||||||||||||||||||||||||||||||

その中で、同大学の工学部情報工学系教授・三浦純氏による、ロボットの視覚に関する「季節や天候の変化に影響を受けない視覚による位置推定装置」と題した講演が開かれた。その模様をお届けする。 ● 移動ロボットのための視覚技術 今回紹介された新技術は、三浦氏と同大学の山本耕資郎氏によって開発された移動ロボットのための視覚技術。特許に出願した発明の名称は「画像データから位置を推定する位置推定方法、位置推定装置及び位置推定プログラム」と長いため、本文中では「今回の技術」と表記させていただく。概要としては「覚えておいた景色」と「いま見ている景色」を比較して自分の位置を知る、というもので、1度走った場所の景観を撮影して覚えておき、別の機会に訪れたときに、以前に記録した景観と現在見ている景観が同じかどうかを比較する。同じ場所を同じ角度から撮影しても、時刻や季節、天候などが異なると、日照量、木々の葉の茂り具合(植物の成長の度合い)、路面の反射具合などさまざまなものが変化する。人の場合、いうまでもなく自宅周辺や勤務先の周辺、行きつけの場所など見慣れた景観なら、見え方が変化しても見間違えることはまずないわけだが、コンピュータで画像比較する場合はそうはいかない。比較する画像の、先ほど述べた諸条件ができる限り近くないと、正解率が大きく下がってしまうのが現状だ。それを、より正確に行なえるようにしたのが今回の技術というわけである。なお、単純に画像比較を行なうだけでなく、移動履歴を利用することで、位置推定精度を向上させている点も特徴だ。 今回の技術は、移動の分野としては下位から「モビリティ」(つまずかないで歩く、障害物を避ける)、「オリエンテーション」(どの方向へ進むか決める、道を見つける)、「ナビゲーション」(地図などを参照して自分の位置を知り、道順を決める)とある中で、最上位のナビゲーションに属する。さまざまな環境での、ナビゲーションをサポートする技術というわけだ。 従来の技術の問題点を挙げると、GPSは高い建物の近くや地下など、衛星からの電波が届きにくい場所での利用が困難なので、正確な地図があらかじめ必要である。レーザ距離センサーなどは非常に高価な上、画像情報を利用しない。画像の直接利用は、前述したように天候や季節の変化に対応できないという問題点がある上に、画像系列をそのまま記憶すると、データ量が膨大となってしまう。 それに対して今回の技術の特徴点を挙げると、季節や天候の変化に影響を受けず、高信頼の位置推定を行なえる点が1つ。そして、画像の撮像を行なうだけで、位置推定のためのモデルを作成できる点がある。さらに、画像をそのまま保存する場合に比べて、はるかに少ないデータ量で済むという点がある。もちろん課題がないわけではなく、それは後ほど紹介させていただく。

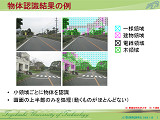

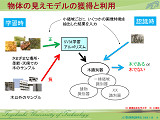

● 画像認識にはサポートベクトルマシン学習アルゴリズムを採用 今回の技術は前述したとおり、1度は知った場所の景観を撮影して系列的に記録しておき、新たに入力された画像とそれらを照合することで位置推定を行なっている。画像を直接比較する方式と似ているわけだが、先ほどから述べているように、時刻や季節、天候の変化で物体・景観の見え方が大きく変化してしまうため、直接比較方式は適切ではない。そこで、2段階の処理を行なうことで対処している。まず、物体認識は物体の見え方の変化を考慮した上で行なう「物体の見えモデル」を採用。そして、画像比較は物体の配置の比較で行なう「各場所における物体の配置モデル」を採用した。物体の見えモデルによる認識は、どの辺にどのような物体があるかということを認識するもの。要するに、その画像に写っているものを大きく複数の要素に分ける作業だ。画像を「ウィンドウ」と呼ばれる細かい領域に区切って、それぞれの領域が一様(空)、建物、電線、木のどの領域かを認識していくのである。道路や人、車といった領域がないのは、人や車が動くからで、道路もそうした人や車などで隠されるから。よって、そうした変化の激しい画面の下半分(主に道路や建物の玄関先など)は、最初から処理しないようにしている。物体認識を行なう作業は、長い期間で見れば建物も建て替わったり、木々も伐採されたりするわけだが、そう短時間に変化しない。固定したものが写っていることの多い画像の上半分で行なう工夫がされているのである。

ポイントとなるのは、建物や木などの認識だろう。かつては物の識別というと、かなり手作業によるところが多かったのだが、近年は学習アルゴリズムを使う手法が増えている。今回の技術で使われているのは「SVM(サポートベクトルマシン)」と呼ばれる学習アルゴリズムだ。仮に、SVMで木を認識させるモデルを作ろうとした場合、まずはさまざまな場所、時刻、季節、天候のもとで撮影された木々の画像を用意する。これを「正」のサンプル画像として、SVM学習アルゴリズムに入力。同時に、空や建物といった木以外の画像を「負」のサンプル画像としてSVM学習アルゴリズムに入力する。これで、木のパターンをデータとして持った識別器(識別モデル)ができあがる。この状態であればサンプル画像と異なった木の画像を入力しても、木と識別されるというわけだ。もちろん、建物や空の画像を入れれば、木とは異なる特徴を持つ画像なので、木ではないと識別される。あとは、同じように建物や空なども識別モデルを作っていけば完成だ。 SVMについてもう少し詳しく説明すると、最大の強みは、カーネルトリックという手法を用いることで、非線形の識別境界が構成できるという点である。データを入力すると、正か負で出力され、その正と負の境界面というものを描くことができる。その境界面を規定するデータのことをサポートベクトルという。出力されたものは、そのすべての正と負を記録しておく必要はなく、サポートベクトルのみを記録する。これによりデータがスリム化されるので、画像の直接比較と比べると、記録する情報量の差で大きなアドバンテージがあるというわけだ。また、高次元のデータに対しても高速に処理ができるといった特徴も持つ。

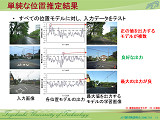

今回の技術では、SVMは実際には場所そのものの「位置モデル」という識別器が作られている。場所を識別するのに、まずはどこが空で、どこが建物かという識別が行なわれるわけだが、識別されたウィンドウたちの配置を場所Aの正のサンプル画像として記録したら、そのほかのサンプル画像を負として記録しているというわけだ。それを、場所B、C……と場所ごとに識別器を構成している仕組みである。 こうした識別の仕組みを用意して、実際に路上で実験が行なわれた。サンプルの位置モデル全部に対して、データを入力し、1度に識別を行なうわけだが、ここでは折れ線グラフの形で答えが出力される。答えのパターンは3通りあり、折れ線グラフの最大出力(最も大きい頂点)が1つだけ正の値を出力すれば、画像がマッチしたということになる。その場所を認識し、自分がどこにいるかがわかったわけだ。それに対し、最大出力だけでなく、複数の出力が正の値となってしまった場合は、似たような場所が複数あって、識別がつかなかったということになる。つまり、自分がどこにいるかわからない、迷っているという状態なわけだ。また、最大出力も負という場合もある。その画像がどこだかわからなかったということで、これも迷っている状態ということだ。

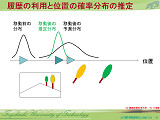

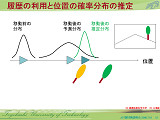

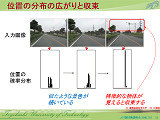

● SVMを補う移動履歴 SVMを用いても、画像マッチングの認識率は100%には至らない。そこで、それを補うのが移動履歴となるわけだが、位置を特定するのではなく、どこにいるかという確率分布で推定する方式が採られている。位置推定として採用されたのは、マルコフ位置推定と呼ばれる手法だ。仕組みとしては、移動前の分布から、移動後の位置の予測分布を推定する。センサーを使っても100%の確率で移動後の位置を予測することはできないため、予測分布の確率の山は裾野がなだらかに広がってしまう。しかし、そこで観測をして画像データを取得し、その中に例えば緑色の葉をした木と紅葉で葉が黄色くなった木が写っていたとしよう。すると、この2本が見える可能性という条件を加えられることから、移動後の位置の推定分布を絞り込める。そののちに、その範囲内で画像比較を行なえば、正確に現在位置を推定できるというわけである。そして、実際に入力画像に対して、位置の確率分布の広がりと収束のサンプルも紹介された。入力画像は道路を写した3枚の画像で、左と中央の2枚は、木の配置も似ており、人の目で見ても一瞬同じに見えてしまうほど似たような風景。右の1枚だけ、道路脇に街灯か標識など特徴的なものが立っており、すぐ見分けがつく。入力画像のそれぞれの下に位置の確率分布のグラフがあり、やはり左の2枚は似たような画像が多いため、収束できない=どこだか判別がついていない。それに対し、右の1枚はグラフ中を1本の棒が延びており、収束した状態。特徴的な物体が見えると、収束するという結果であった。このように、移動履歴(移動推定の確率分布)を考慮するということのメリットは、1つに絞りきらないので、失敗する可能性を抑えられるということである。また、移動推定を行なうことで範囲を絞り込めるので、SVMの画像マッチングを行なう際も、それだけ無駄な計算をしなくて済むという点もメリットだ。そのほか、ムービーでの推定実験例も披露された。

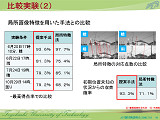

● ほかの方式との比較実験の結果 また、比較実験の正答率と最高得点率の比較も紹介された。6月20日17時の晴れという環境で撮影されたある場所の画像に対し、比較画像として同日10分後の晴れ(画像A)、6月22日の17時の雨(画像B)、7月24日19時の晴れ(画像C)、10月29日14時の曇り(画像D)という4種類の画像を用意。比較実験は、画像の直接比較による位置推定、履歴を使わない位置推定、履歴を使った位置推定の3種類で行なった。比較数値は2種類あり、正しい場所を正しく識別したかという「正解率」と、正しく反応した上で点数が1番高かったかどうかという「最高得点率」だ。今回の技術の履歴を使った位置推定は、全画像に対して正解率が100%という結果がでた。最高得点率も、Aで93.6%、雨という天候の異なるBで81.3%、夕方と夜で日照量が大きく異なるCで79.3%、同じ昼間だが曇りという日照量と天候が異なるDで79.2%だった。それに対して直接画像比較の場合、Aは正解率78.6%で最高得点率60.2%だが、Bの正解率は23.2%で最高得点率は13.1%と一気に低下。CとDに至っては、正解率も最高得点率もひと桁台だった。また、今回の技術だが移動履歴を使わない場合の正解率と最高得点率は、直接比較よりはずっと高いものの、Aが95.7%と79.6%、Bが86.5%と59.4%、Cが81.3%と56.1%、Dが72.7%と43.2%となっていた。 さらに別の実験として、現在物体認識をする際の技術としてよく用いられている、物体の局所部分の画像の特徴を用いる局所特徴法があるが、それとの比較も行なわれた。同じ基本画像と画像A~Dによる比較で、最高得点率での比較である。局所特徴法ではAが97.7%、Bが75.4%、Cが85.1%、Dが68.2%。Aは局所特徴法の方が上回っているが、環境が大きく異なるB~Dに関しては、履歴を使った位置推定の方が上回る結果となった。そして、初期位置が未知の状況からの収束確率の比較実験も実施。その結果は、履歴を使った位置推定が93.3%だったのに対し、局所特徴法が71.1%だった。

● 今回の新技術に関するまとめ 最後に、特徴や課題などを紹介。まず特徴に関しては「季節や天候の変化に影響を受けず、高信頼の位置推定ができる」点が挙げられる。また「安価なカメラを使用して撮像するだけで自動的に位置推定のためのモデル生成を行なえる」点も特徴だ。さらに「画像そのものに比べはるかにサイズの小さなモデルのみを記録しておけばいい」という点もメリットである(各ウィンドウが建物か木かといったことさえ記録しておけばよい)。逆に実用化に向けた課題としては、まだ特定の環境(大学の周辺)での実験しか行なわれていないため「さらに広範な環境での検証実験の必要性」という点が挙げられる。さらに大きな問題となるのが「学習用の景色のデータベースの構築」だが、道路の画像そのものは、Googleのストリートビューなどで見られるようにすでに構築されているので、そのようなデータを使う(使用料などの問題はあるが)といった方法もある。サーバーに基本画像を置く仕組みにすれば、すべての機器がデータを共有でき、個々の機器があらゆる道路を走るといった必要はなくなるので、そうしたシステムも考慮しているそうだ。また、現在はかなり高性能なPCを使用しているので、さらなる計算コストの削減と小型化といった「ソフトウェアの改善」も重要である。それから、「GPSなどほかの位置情報との連携による高機能化」も挙げられていた。 想定される用途だが、1つは「移動ロボットの視覚(画像)を用いた自律ナビゲーションシステム」。それから、現在位置の確認面で「カーナビゲーションシステム」の機能強化もその1つ。また、ロボットとは離れるが「新しいビルなどの建築による街並みの変化のための景観評価」や「季節・天候の変化に対応できる風景画像検索」などもあった。 今後は、必要に応じて認識に用いる物体を増やすことにより、広範囲の環境に適用していくとする。また、移動ロボット、ナビゲーションシステム、景観モデリング、画像処理の技術を持つ企業・機関などとの共同研究も考えているそうだ。 そのほか関連研究として、移動の第1段階であるモビリティ分野の「障害物の発見と移動可能領域地図の自動生成」や、第2段階のオリエンテーション分野の「さまざまな状況での道路領域検出」といったことの研究を行なっていることも紹介された。 今回の技術は、人間の精度に近い、時にはそれを凌駕する正確さを持つ技術である。目的地に移動するには、現在位置が確認できなければ話にならない。将来的に、ロボットに道案内してもらうといったことも実現できると期待ができる技術といえる。また、自動車の自動運転は、現状だと路面に案内用の機器を埋め込む方式も考えられているが、それだと非常にインフラの整備が大変である。GPSなど既存の技術に加え、自動車や歩行者、自転車といった路上に存在しうる人や物の画像認識技術などと組み合わせていけば、車だけでの自動運転技術も確立できそうだ。人と同等、時にはそれ以上という景観認識技術は、さまざまな場面で応用ができそうなので、製品への応用がとても楽しみになる講演であった。 ■URL 国立大学法人豊橋技術科学大学 http://www.tut.ac.jp/ 国立大学法人豊橋技術科学大学 情報工学系行動知能システム学研究室(三浦研究室) http://www.aisl.ics.tut.ac.jp/~jun/index-j.html

( デイビー日高 )

- ページの先頭へ-

|